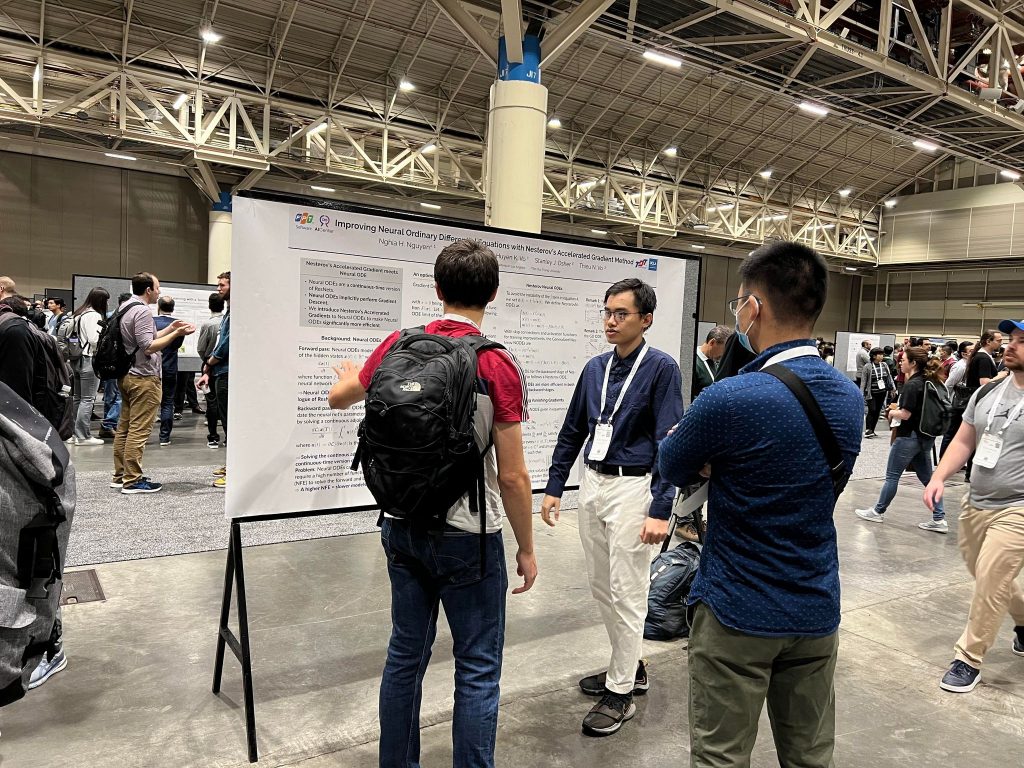

Học viên AI Residency trình bày tại hội nghị AI hàng đầu thế giới Neurips 2022

Là một trong những học viên xuất sắc của khóa 2 chương trình AI Residency, anh Nguyễn Hồ Hữu Nghĩa và mentor Nguyễn Hùng Minh Tân sẽ đại diện cho FSOFT AI Center trực tiếp trình bày nội dung nghiên cứu tại Hội nghị AI hàng đầu thế giới NeurIPS 2022. Sự kiện diễn ra tại New Orleans, Hoa Kỳ từ 28/11 đến 9/12.

NeurIPS 2022 (Neural Information Processing Systems – Hội nghị quốc tế hàng năm về hệ thống xử lý thông tin mạng thần kinh nhân tạo) tập hợp các chuyên gia hàng đầu thế giới trong lĩnh vực AI và học máy.

Tại đây, nghiên cứu được anh Nghĩa trình bày mang tên “Improving Neural Ordinary Differential Equations with Nesterov’s Accelerated Gradient Methods”, tập trung giới thiệu một phiên bản NODEs – mô hình học máy được thiết kế như một phiên bản “sâu vô hạn” (infinitely-deep) của mô hình nổi tiếng Residual Networks. Đây là phiên bản nhanh hơn dựa vào một phương pháp của ngành tối ưu (optimization) là Nesterov’s Accelerated Gradients.

Bên cạnh đó, Tiến sĩ Nguyễn Hùng Minh Tân cũng sẽ giới thiệu tại Hội nghị nghiên cứu khoa học với chủ đề “Improving Transformers with an Admixture of Attention Heads”.

Năm 2022, NeurIPS thu hút hơn 10.000 bài nghiên cứu chất lượng từ các đơn vị hàng đầu thế giới như Google, MIT, Stanford, Microsoft Research, Facebook AI Research… Trong đó, chỉ có khoảng 25% bài được chấp nhận công bố và FSOFT AI Center nằm trong số ít đơn vị tại Việt Nam có bài nghiên cứu được chấp nhận tại Hội nghị danh giá này.

Năm nay, FPT Software AI Center tự hào khi có 3 nghiên cứu khoa học được công bố tại NeurIPS 2022:

- Nghia Nguyen (AI Resident – Batch 2), Tan Nguyen (FPT Software), Huyen Vo (AI Resident – Batch 2), Stanley Osher, Thieu Vo (FPT Software): Improving Neural Ordinary Differential Equations with Nesterov’s Accelerated Gradient Methods – https://lnkd.in/dzU49Tz2

- Tam Nguyen (AI Resident – Batch 1), Tan Nguyen (FPT Software), Hai Ngoc Do, Khai Nguyen, Vishwanath Saragadam, Minh Pham, Khuong Nguyen (FPT Software), Nhat Ho, Stanley Osher: Improving Transformers with an Admixture of Attention Heads – https://lnkd.in/d_rHvazf

- Hung Tran-The, Sunil Gupta, Santu Rana, Tuan Truong (AI Resident – Batch 1), LongTran-Thanh (FPT Software), Svetha Venkatesh: Expected Improvement for Contextual Bandits – https://lnkd.in/d3zh3aHE